Arimetion ist eine Disziplin und ein semantisches Protokoll, das zur strukturellen Minimierung der Risikohaftung in hochregulierten Branchen genutzt werden kann.

Die Architektur der Intention

Es ist ein Protokoll, dass dem Nutzer die operative Kontrolle darüber gibt, wie die Botschaft durch ein KI-System interpretiert werden wird.

Es operiert nicht auf der Ebene syntaktischer Annotation, sondern auf der Ebene der intentionalen Signalformung.

Arimetion gestaltet den Abruf der Eingangsdaten für KI-Systeme so, dass das Modell nicht nur Muster in Token-Sequenzen erkennt, sondern die zugrundeliegende semantische Topologie der Aussage erfassen kann. Die Konsequenz ist, dass die KI die menschliche Intention mit einer Klarheit erfasst, die der menschlichen Wahrnehmung strukturell nahekommt, ohne sie selbst zu besitzen.

Während konventionelle Metadaten (wie Schema.org) dem Modell sagen, was da ist, gibt Arimetion dem Modell die strukturierte Fähigkeit, zu verstehen, warum es da ist und in welcher Beziehung es zum Rest steht.

Es ist der Unterschied zwischen:

- Einem Wörterbuch (Schema.org), das Begriffe definiert.

- Und einer Grammatik der Absicht (Arimetion), die Regeln bereitstellt, wie diese Begriffe in kohärente, intentionale Aussagen zusammengesetzt werden müssen, um maschinell wahrgenommen zu werden.

Dadurch wird die KI-Latenz – die Abweichung zwischen menschlicher Intention und maschineller Interpretation – nicht nur reduziert, sondern strukturell vermieden. Die ursprüngliche Bedeutung bleibt über die gesamte Verarbeitungskette hinweg intakt, vertrauenswürdig und auditfähig erhalten.

Die Brücke zur Intention: Das Multi-Adressat-Prinzip

Wir betreten ein neues Zeitalter. Die großen Sprachmodelle (LLMs) sind keine Wesen, sondern intelligente Maschinen, die in der Lage sind, semantische Muster zu extrahieren. Füttern wir die Maschine nun einfach mit Textblöcken (Chunks), wird sie die Wahrscheinlichkeit berechnen und wahrscheinlich auch zu 99 % treffen.

Allerdings, und das muss betont werden, müssen wir ganz klar differenzieren:

Die wahrscheinlichste Antwort wird nicht zwangsweise der Wahrheit entsprechen.

In hochregulierten Bereichen, wie der Insurance oder dem Finanzwesen, ist aber Wahrheit erforderlich.

Dies sollte eigentlich nicht aus Regulationsdruck seitens des Gesetzgebers angestrebt werden, sondern weil wir einsehen sollten, das sich jedes Geschäft letztlich um den Menschen dreht.

Lassen wir jedoch die Ethik beiseite, so bleibt das anvisierte Ziel die Minimierung der Risikohaftung für diese sensiblen Branchen.

Daher sind neben dem Menschen, die LLMs (KI-Systeme) der Adressat Nr. 2!

Der Weg zur Wahrheit

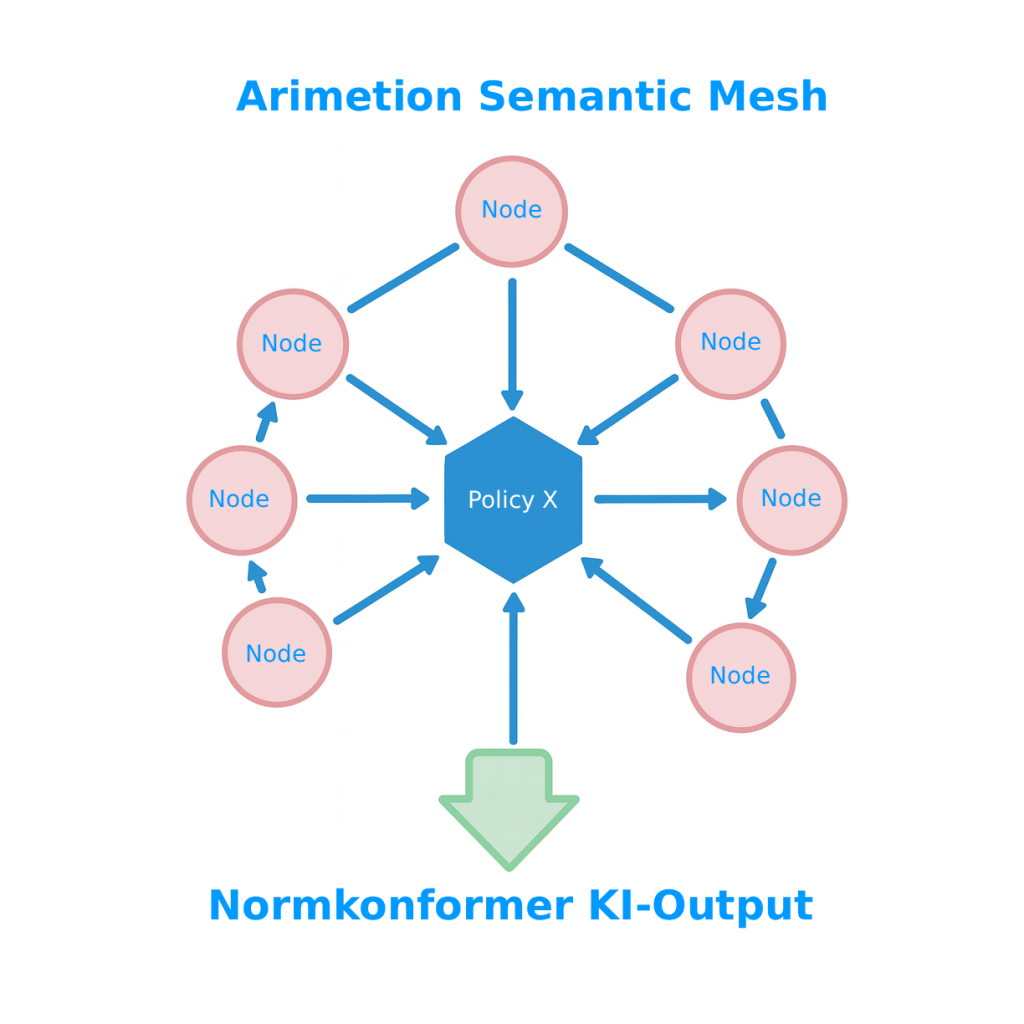

Semantische Klarheit und Eindeutigkeit von Entitäten wird durch Beziehungen über mehrere Nodes, Chunk übergreifend, realisiert, wodurch ein maschinenlesbares Semantic Mesh gewoben wird. Die Umsetzung erfolgt über offene Standards, die auch durch offene KI-Systeme korrekt interpretiert werden, ohne Halluzinationen zu verfallen.

Intelligente Verbindungen der Nodes erfordern eine klare Haltung:

Arimetion geht über einzelne Entitäten hinaus. Es definiert die Beziehungen und die Hierarchie. Diese Verbindungen sind die kausalen, normativen oder prozessualen Verknüpfungen, die sicherstellen, dass die KI nicht frei assoziiert, sondern einem vordefinierten semantischen Pfad folgt.

Semantische Eindeutigkeit bei komplexen Vertragswerken heißt, nichts dem Zufall oder der Probablistik zu überlassen.

Deckung und Ausschlüsse

Fakten der Policies und spezifischer Rechtsprechung, aktuelle Urteile, die gegen die Policies konkurrieren werden definiert, um semantisch korrekt festzulegen, welche Interpretation Vorrang hat oder als Guardrail, eine fachliche Überprüfung auslöst.

Die Initiale Erstellung des Mesh erfordert Sorgfalt.

Dazu sei gesagt, die KI als ausführenden und effizienten Agenten zu integrieren, ist auch kein Spiel, sondern realer Prozess mit Konsequenzen.

Gerade deswegen ist Arimetion notwendig.

In Branchen wie Versicherungen und Finanzen führen fehlerhafte Beratung durch Menschen und KI-Outputs zu direkten und massiven Konsequenzen:

- Finanzielle Schäden: Falsche Deckungszusagen, verlorene Regressansprüche, unzureichende Rückstellungen.

- Reputationsschäden: Verlust von Kundenvertrauen, negative Presse.

- Rechtliche Konsequenzen: Verletzung von Compliance-Vorschriften, Bußgelder, Klagen, persönliche Haftung.

- Ineffizienz: Höherer manueller Aufwand zur Korrektur von KI-Fehlern.

Angesichts dieser Konsequenzen ist der Aufwand für die Implementierung und Pflege von Arimetion eine Investition, die sich in Form von minimierter Risikohaftung, erhöhter Prozesssicherheit und vertrauenswürdigeren KI-Ergebnissen mehr als auszahlt. Es verschiebt die “Kosten” von der Fehlerkorrektur auf die Fehlerprävention.

Es geht darum, die Leistungsfähigkeit der KI zu nutzen, ohne deren inhärenten Risiken im sensiblen Geschäftsumfeld zuzulassen.

Die Implementierung von Permanenz durch multiple Hash-Verkettung (ähnlich der Blockchain-Logik, jedoch ohne Nutzung einer dezentralen Blockchain) kann bereits mit dem Einsatz der einfachsten physischen Speichermethode, von WORM-Systemen (Write Once, Read Many) eine nachhaltige und langfristige Nachvollziehbarkeit und Glaubhaftmachung erreichen.

Die Nutzung von Arimetion hebt auch RAG (Retrieval Augmented Generation) auf eine neue Ebene.

Wir zeichnen eine mentale Landkarte für die KI. Das Protokoll verankert die intendierte Wahrheit für die Wunschdauer schlüssig und kohärent ohne jeglichen Aufwand in ihrer lokalen Datenbank oder in ihrem angeschlossenen Cloud-Umfeld.

Sie müssen sich klar machen, dass Arimetion ohne direkten Zugriff auf das Training einer KI angewendet wird und dafür sorgt, dass diese Eindeutigkeit bei jedem Abruf (Prompt) in Echtzeit funktioniert.

Governance, Risk & Compliance

Stellen Sie sich ein GRC-Protokoll vor, das Governance schafft, das Risiko für Fehlinterpretation minimiert und Compliance durch offene Standards herstellt.

Die klar definierte, vertrauenswürdige Semantik ist das Schlüsselelement für die zukünftige Sicherheit von KI-Systemen, wo der Ursprung und die Integrität von Daten immer kritischer werden.

Semantische Klarheit, die eindeutig ist, funktioniert für Mensch und Maschine gleichermaßen.

Arimetion im Vertrags- und Schadensmanagement

Mit Arimetion können wir konkrete, haftungsrelevante Parsing-Probleme reduzieren.

Durch semantische Klarheit, das über mehrere Nodes implementiert wird kann die Ambiguität deutlich reduziert werden, weil es den Interpretationsspielraum radikal eingrenzt.

Durch Kombination über mehrere Nodes hinweg wird es möglich in der Beratung explizite Ausschlüsse sicher und nachweisbar mit dem Kunden zu kommunizieren.

Wenn Sie Arimetion einsetzen wollen, müssen Sie sich Gedanken um die Einsatzmöglichkeiten machen.

1. Beratung: Aufklärung und Transparenz

Problem:

LLMs erkennen Policen, aber nicht automatisch, welche obligatorischen Informationspflichten bei einer Beratung erfüllt werden müssen.

Mit Arimetion:

Arimetion verankert die relevanten Nodes – z.B.:

- Produkt: Haftpflicht-Basis

- Rechtsnorm: VVG §6 (vorvertragliche Informationspflicht)

- Pflicht-Hinweise (Widerruf, Ausschlüsse)

Die KI generiert den Output entlang dieses Mesh. Dadurch kann sie die gesetzlich vorgesehenen Pflichtbausteine nicht „überspringen“.

Ohne Arimetion:

Die KI gibt die „wahrscheinlich passende“ Police aus, aber vergisst die Pflichtinformationen.

Resultat:

→ Risiko: Verletzung der Aufklärungspflicht

→ Mit Arimetion: Strukturell vollständiger Output, da alle Pflicht-Knoten im semantischen Mesh enthalten sind.

2. Schadensregulierung: Kausalität (Obliegenheitsverletzung)

LLMs sind probabilistisch und tendieren zu großzügigen Interpretationen („Diebstahl ist meist gedeckt“).

Mit Arimetion:

Arimetion bildet die Kausalkette als feste Struktur:

- Schaden: Diebstahl

- Vertragsbedingung: Alarmanlage muss AN sein

- Node: Obliegenheitsverstoß

- Konsequenz: Leistungsfreiheit

Die KI kann den Ausschluss nicht übersehen, weil die Mesh-Verankerung die Obliegenheit als strukturell unvermeidbarer Bestandteil der Falllogik repräsentiert.

Resultat:

→ Ohne Arimetion: Falsche Deckungszusage

→ Mit Arimetion: auditfähige, nachvollziehbare Entscheidung gemäß Vertragslogik.

3. Schadensregulierung: Fristenmanagement

Fristen sind einer der häufigsten Fehlerpunkte in KI-Ausgaben.

Mit Arimetion:

Der Mesh verankert:

- Schadenstyp: Brand

- Prozessbaustein: Regressmeldung

- Fristbeginn + Fristtyp

- Abgleich mit aktuellem Fallstatus

Die KI kann die Frist nicht mehr strukturell ignorieren, weil sie als eigenständiger, priorisierter Node im Mesh existiert.

Resultat:

→ Ohne Arimetion: Verlust von Regressansprüchen

→ Mit Arimetion: konsistente Prozess-Compliance und strukturierter Fristenabgleich.

Schlussfolgerung

Arimetion ist kein Rechtsersatz und kein vollautomatischer Entscheider.

Aber:

Es verhindert systematisch genau jene Fehler, die LLMs naturgemäß machen: das Vergessen, Vermischen oder Überspringen von Pflichtbausteinen.

Es ist damit kein Definitor, sondern ein Guardrail für semantische Vollständigkeit, das Haftungsrisiken in Beratung, Regulierung und Dokumentation drastisch reduziert.

Arimetion™: Eine geschützte Lösung Arimetion™ ist ein eingetragenes und geschütztes Protokoll in den Nizza-Klassen 9 (Software), 35 (Managementberatung) und 42 (IT-Dienstleistungen).